AVIS ET CONSULTATION DU PERSONNEL DE L'ACS 11-348 LA RÉVOLUTION DE L'INFORMATIQUE : REDÉFINIR LE DROIT CANADIEN DES VALEURS MOBILIÈRES

PARTIE 3 - ORIENTATIONS POUR L'ÉMETTEUR ASSUJETTI

(émetteurs assujettis qui ne sont pas des fonds d'investissement)

Brian Koscak, vice-président de la PCMA

Cet article est la troisième partie d'une série de trois articles consacrés à l'examen de l'action des Autorités canadiennes en valeurs mobilières (ACVM). (CSA)) publication de Avis et consultation du personnel du CSA 11-348 - Applicabilité des lois canadiennes sur les valeurs mobilières et utilisation des systèmes d'intelligence artificielle sur les marchés des capitaux (le Avis). Cet article examine l'application spécifique de l'avis aux émetteurs assujettis qui ne sont pas des fonds d'investissement (Émetteurs non IF), comme l'exploitation minière, le pétrole et le gaz, l'immobilier, la biotechnologie et d'autres émetteurs non assujettis aux fonds d'investissement. Elle concerne principalement la divulgation de l'utilisation de l'intelligence artificielle (AI) par un émetteur assujetti et leurs obligations d'information périodique et continue en vertu de la législation applicable en matière de valeurs mobilières.

La première partie aborde les thèmes généraux identifiés par les ACVM, notamment la neutralité technologique dans la réglementation des valeurs mobilières, la gouvernance et la surveillance de l'IA, les exigences d'explicabilité, les obligations d'information et la gestion des conflits d'intérêts liés à l'IA. Vous pouvez accéder à la partie 1 ici.

Dans la deuxième partie, nous avons abordé l'application des systèmes d'IA au droit canadien des valeurs mobilières en ce qui concerne les courtiers, les conseillers et les gestionnaires de fonds d'investissement (OIF), et les fonds de la série 81 gérés par les GFI. Vous pouvez accéder à la partie 2 ici.

Cette série d'articles vise à fournir à certains participants au marché[1] avec une compréhension approfondie de la façon dont les lois canadiennes sur les valeurs mobilières réglementent "Systèmes d'IA"[2] sur nos marchés de capitaux et les obligations qui en découlent.

Orientations spécifiques pour les émetteurs autres que les fonds d'investissement

L'avis explique comment les émetteurs non financiers peuvent communiquer clairement et efficacement aux investisseurs l'utilisation qu'ils font des systèmes d'intelligence artificielle. Les ACVM s'appuient sur les obligations d'information continue qui incombent aux sociétés en vertu du règlement 51-102 Obligations d'information continueLes entreprises doivent fournir des mises à jour par le biais de leur rapport de gestion (RAPPORT DE GESTION) et le formulaire d'information annuel (AIF). Des exigences similaires s'appliquent aux dépôts de prospectus, ce qui garantit une information cohérente, que vous achetiez des actions sur le marché libre ou que vous participiez à une nouvelle offre.

L'accent mis par les ACVM sur l'accès exact, égal et opportun aux informations importantes inclut l'utilisation de l'IA. Les ACVM disent essentiellement que dans un monde où les capacités de l'IA peuvent évoluer rapidement, les investisseurs ont besoin de mises à jour régulières sur la façon dont les émetteurs assujettis utilisent ces technologies et sur les risques auxquels ils pourraient être confrontés. Il ne s'agit pas seulement de cocher des cases réglementaires, mais de s'assurer que les investisseurs disposent des informations dont ils ont besoin pour prendre des décisions d'investissement éclairées.

Les ACVM affirment qu'il n'existe pas d'approche unique en matière de divulgation de l'information sur l'IA. Elles reconnaissent qu'une entreprise technologique qui construit des systèmes d'IA à partir de zéro est confrontée à des obligations d'information très différentes de celles d'un détaillant qui utilise une IA standard pour la gestion de ses stocks. En outre, les ACVM précisent que les émetteurs non financiers doivent fournir des informations proportionnelles à l'importance de leurs systèmes d'IA et aux risques associés, en évitant les formules passe-partout génériques. Les éléments d'information clés devraient améliorer la compréhension des investisseurs en couvrant plusieurs domaines cruciaux : la définition de l'entreprise et l'utilisation importante de l'IA (qu'elle soit développée en interne ou en externe), les risques importants et les mesures de gouvernance correspondantes, les impacts potentiels sur les opérations commerciales et la performance financière, et tout facteur important ou hypothèse sous-jacente aux informations prospectives sur l'utilisation des systèmes d'IA, y compris les mises à jour d'informations précédemment divulguées.

Les émetteurs non financiers doivent noter que les ACVM contrôleront leurs documents d'information concernant l'utilisation des systèmes d'IA, dans le cadre de leur programme d'examen de l'information continue.

(a) Divulgation de l'utilisation commerciale actuelle des systèmes d'IA

Le message des ACVM est sans ambiguïté pour tous les émetteurs assujettis dont les activités impliquent l'utilisation de systèmes d'IA ou la production de produits liés à l'IA : si c'est important, il faut en parler. Mais la manière d'en parler compte tout autant que ce que l'on dit.

Compte tenu de la complexité des systèmes d'IA, les émetteurs assujettis doivent fournir des informations détaillées qui aident les investisseurs à comprendre ce qui se passe sous le capot. C'est comme la différence entre un mécanicien qui expliquerait exactement ce qui ne va pas avec votre voiture et celui qui dirait simplement "il y a un problème de moteur".

La CSA fournit une liste de contrôle en sept points pour la divulgation de l'information sur l'IA :

- Définition: Les émetteurs assujettis doivent expliquer comment ils définissent l'IA. Il ne s'agit pas de copier les définitions des manuels, mais d'expliquer comment un émetteur assujetti comprend et aborde la technologie de l'IA.

- Le quoi: Précisez la nature des produits ou services d'IA d'un émetteur assujetti. Que construisez-vous ou utilisez-vous réellement ?

- Comment et pourquoi: Expliquer comment l'émetteur assujetti utilise les systèmes d'IA, quels sont les avantages qu'il en retire et les risques qu'il encourt.

- L'impact: Détailler les impacts actuels ou anticipés de l'utilisation ou du développement de systèmes d'IA sur l'activité et la situation financière d'un émetteur assujetti.

- Contrats matériels: Indiquer tout contrat important d'un émetteur assujetti relatif aux systèmes d'IA.

- Le voyage: Expliquer les événements ou les conditions qui ont influencé l'évolution de l'émetteur, y compris tout investissement important dans l'IA ; et

- L'avantage concurrentiel: Expliquer comment l'utilisation de l'IA par l'émetteur assujetti affecte sa position concurrentielle sur ses marchés primaires.

Au-delà de ces exigences fondamentales, les émetteurs non IF doivent lever le voile sur leurs sources de données, qu'ils construisent leurs propres systèmes d'IA ou qu'ils les achètent à des tiers. Les ACVM estiment que ce niveau de transparence pourrait aider les investisseurs à distinguer les émetteurs assujettis dotés de véritables capacités d'IA de ceux qui ne font que surfer sur la vague de l'IA.

(b) Facteurs de risque liés à l'IA

En ce qui concerne l'information sur les facteurs de risque liés à l'IA, les ACVM indiquent que les émetteurs assujettis ne peuvent pas se cacher derrière des avertissements passe-partout sur les risques technologiques généraux. L'avis précise que les ACVM attendent des informations spécifiques à l'entité sur la manière dont l'IA peut influer sur les activités d'un émetteur non financier.

Les ACVM insistent sur le contexte. L'émetteur non financier ne peut pas se contenter d'énumérer les risques liés à l'IA ; il doit expliquer comment son conseil d'administration et sa direction évaluent et gèrent ces risques. Cette exigence devrait inciter les émetteurs non financiers à réfléchir plus en profondeur à leurs pratiques de gouvernance en matière d'IA, notamment aux mécanismes de responsabilité, de gestion des risques et de surveillance de l'utilisation des systèmes d'IA dans leurs activités.

En ce qui concerne la divulgation des risques, les ACVM mettent l'accent sur trois éléments clés : l'origine des risques, ce qui pourrait se produire s'ils se concrétisaient et les mesures prises par les entreprises pour les prévenir. L'avis stipule que les émetteurs non IF doivent divulguer les incidents antérieurs importants au cours desquels les systèmes d'IA ont soulevé des préoccupations d'ordre réglementaire, éthique ou juridique.

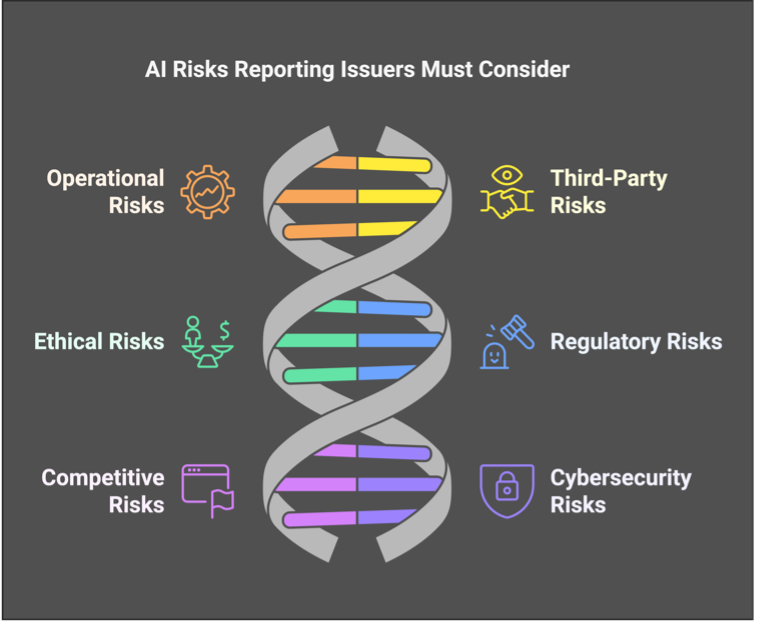

Les ACVM ont identifié six grandes catégories de risques liés à l'IA que les émetteurs assujettis doivent prendre en compte et mentionner s'ils sont importants :

1. Risques opérationnels : Il ne s'agit pas seulement des défaillances du système. Les émetteurs non IF doivent s'attaquer à tous les problèmes, depuis les conséquences involontaires et la désinformation jusqu'aux préjugés et aux défis technologiques. Ils doivent également s'attaquer aux questions épineuses de la propriété, de l'origine et de la maintenance des données ;

2. Risques pour les tiers: Reconnaissant que les émetteurs non IF peuvent faire appel à des fournisseurs d'IA externes, les ACVM suggèrent de fournir des informations spécifiques sur les risques liés au fait de dépendre d'autres personnes pour les capacités d'IA ;

3. Risques éthiques : Peut-être la catégorie la plus avant-gardiste, elle couvre les questions sociales et éthiques découlant de l'utilisation de l'IA, notamment les conflits d'intérêts, les droits de l'homme, la protection de la vie privée et les incidences sur l'emploi. Les émetteurs assujettis doivent tenir compte de la manière dont ces questions pourraient influer sur leur réputation, leur responsabilité et leurs coûts ;

4. Risques réglementaires: La réglementation en matière d'IA évoluant rapidement, les émetteurs non-IF doivent expliquer comment l'évolution des exigences légales et d'autres normes pourrait affecter leurs utilisations ou initiatives en matière d'IA ;

5. Risques concurrentiels : Les ACVM suggèrent que les émetteurs non financiers examinent comment l'évolution rapide de la technologie de l'IA pourrait menacer leur position sur le marché (c'est-à-dire leurs activités, leur situation financière et leur réputation) ; et

6. Risques liés à la cybersécurité : Enfin, et ce n'est pas le moins important, les émetteurs non IF doivent se pencher sur les vulnérabilités spécifiques en matière de sécurité que les systèmes d'IA pourraient introduire dans leurs opérations.

(c) Déclarations promotionnelles sur l'utilisation de l'IA (lavage de l'IA)

Dans une section pointue de l'avis, les ACVM s'attaquent directement à l'engouement pour l'IA dans les communications d'entreprise. Vous voulez prétendre que votre entreprise utilise l'IA "à grande échelle" ? Vous feriez mieux d'être prêt à le prouver. Les affirmations vagues et non fondées concernant les capacités de l'IA ne seront pas acceptées.

Les ACVM réitèrent l'exigence d'une divulgation équilibrée. Les entreprises ne peuvent pas se contenter de vanter les avantages de leurs initiatives en matière d'IA, elles doivent accorder le même temps d'antenne aux risques et aux défis. C'est comme si l'on exigeait que les publicités pour la perte de poids passent autant de temps à discuter des effets secondaires potentiels qu'à montrer des photos "avant et après".

Les ACVM reconnaissent que la communication d'informations, y compris sur l'IA, ne se limite plus aux documents officiels. Les messages sur les médias sociaux concernant les initiatives en matière d'IA peuvent entraîner des obligations d'information sur les valeurs mobilières, même s'ils ne s'adressent pas explicitement aux investisseurs. Le message est clair : que vous déposiez un rapport annuel ou que vous parliez sur Twitter de votre dernier projet d'IA, les mêmes règles de divulgation précise et équilibrée s'appliquent.

L'avis insiste sur la nécessité de divulguer les nouvelles défavorables aussi rapidement et complètement que les développements favorables. Il ne s'agit pas seulement d'empêcher une divulgation sélective, mais de veiller à ce que les investisseurs obtiennent une image complète et équilibrée des initiatives d'une entreprise en matière d'IA. Les ACVM indiquent effectivement aux entreprises qu'elles ne peuvent pas enterrer les mauvaises nouvelles en matière d'IA tout en amplifiant les réussites.

(d) AI et informations prospectives

L'avis présente les attentes des ACVM en ce qui concerne les obligations d'information sur les IA impliquant des informations prospectives (FLI). Lorsque vous faites des prédictions sur le succès de vos initiatives en matière d'IA, vous devez vous assurer que vous avez plus que des projections optimistes pour étayer vos affirmations ; sinon, vos déclarations peuvent être considérées comme des déclarations erronées.

L'avis sur la FLI est spécifique. Vous voulez dire aux investisseurs que votre nouveau système d'intelligence artificielle augmentera vos revenus de 5% ? Mieux vaut être prêt à montrer votre travail. Les ACVM s'attendent à ce que soient divulgués non seulement la prédiction, mais aussi tous les facteurs importants et toutes les hypothèses qui ont permis de l'établir. C'est comme si l'on exigeait des météorologues qu'ils expliquent non seulement la température du lendemain, mais aussi la manière dont ils sont parvenus à cette prédiction.

Les ACVM rappellent aux émetteurs autres que des fonds d'investissement l'obligation de mettre à jour en permanence les informations financières déjà publiées. Les émetteurs assujettis ne peuvent pas se contenter de faire de grandes prédictions sur leur avenir en matière d'IA, puis se taire. Ils doivent tenir les investisseurs informés des progrès accomplis dans la réalisation de ces objectifs et expliquer tout écart important par rapport aux prévisions antérieures. Bien que les émetteurs non IF aient la possibilité de publier des informations actualisées dans un communiqué de presse avant de déposer le rapport de gestion, ils ne peuvent pas se fier uniquement aux communiqués de presse - les informations doivent finir par être intégrées dans leurs documents officiels.

Conclusion : La nouvelle ère de la communication d'entreprise par l'IA

L'avis des ACVM illustre la façon dont les organismes canadiens de réglementation des valeurs mobilières abordent la divulgation de l'information sur l'IA dans les marchés financiers. Dans cette série en trois parties, nous avons examiné comment les ACVM adaptent les cadres existants en matière de valeurs mobilières pour relever les défis uniques posés par les systèmes d'IA, depuis les grands principes réglementaires jusqu'aux directives spécifiques pour les personnes inscrites et les émetteurs non IF.

Pour les émetteurs non financiers en particulier, le message est clair : une information pertinente sur l'IA exige un examen attentif de l'importance relative, de la spécificité et de la surveillance continue. Les ACVM s'attendent à ce que les entreprises aillent au-delà d'un " lavage de cerveau " superficiel pour fournir aux investisseurs des informations détaillées et équilibrées sur leurs initiatives en matière d'IA, les risques associés et les répercussions potentielles sur leurs activités. Qu'il s'agisse de la mise en œuvre actuelle de l'IA, des facteurs de risque, des déclarations promotionnelles ou des informations prospectives, les entreprises doivent s'assurer que leurs informations sont substantielles, exactes et opportunes.

Alors que l'IA continue de transformer les marchés de capitaux canadiens, ce cadre réglementaire fournit des orientations cruciales aux acteurs du marché tout en conservant suffisamment de souplesse pour s'adapter à l'évolution rapide de la technologie. Le défi pour les émetteurs assujettis à l'avenir sera de développer des pratiques d'information solides qui satisfont aux exigences réglementaires tout en fournissant aux investisseurs les informations dont ils ont besoin pour prendre des décisions d'investissement éclairées dans un paysage de marché axé sur l'IA.

Prochaines étapes

La période de consultation de la CSA se termine le 30 mars 2025. La consultation donne aux parties prenantes du secteur l'occasion de façonner l'évolution de la réglementation de l'IA sur les marchés financiers canadiens. Par ce processus de consultation, les ACVM cherchent à favoriser l'innovation responsable en matière d'IA tout en maintenant l'intégrité du marché et la protection des investisseurs. Les questions posées dans l'avis sont présentées ci-dessous.

Avis CSA Questions de consultation

- Existe-t-il des cas d'utilisation des systèmes d'IA qui, selon vous, ne peuvent être pris en compte sans règles nouvelles ou modifiées, ou sans exemptions ciblées des règles actuelles ? Veuillez préciser les changements que vous jugez nécessaires.

- Faut-il prévoir des règles et/ou des orientations nouvelles ou modifiées pour traiter les risques liés à l'utilisation des systèmes d'IA sur les marchés de capitaux, notamment en ce qui concerne les approches de gestion des risques pour le cycle de vie des systèmes d'IA ? Les entreprises doivent-elles élaborer de nouveaux cadres de gouvernance ou peuvent-elles adapter les cadres existants ? Devrions-nous envisager d'adopter des mesures ou des normes de gouvernance spécifiques (par exemple, la ligne directrice E-23 du BSIF sur la gestion du risque de modèle, l'ISO, le NIST) ? [3]

- Les données jouent un rôle essentiel dans le fonctionnement des systèmes d'IA et constituent la base sur laquelle leurs résultats sont créés. Quelles considérations les participants au marché devraient-ils garder à l'esprit lorsqu'ils déterminent les sources de données à utiliser pour les systèmes d'IA qu'ils déploient (p. ex. la confidentialité, l'exactitude, l'exhaustivité) ? Quelles mesures les participants au marché devraient-ils prendre lorsqu'ils utilisent des systèmes d'IA afin de tenir compte des risques uniques liés aux sources de données utilisées par les systèmes d'IA (p. ex. des mesures qui amélioreraient la confidentialité, l'exactitude, la sécurité, la qualité et l'exhaustivité des données) ?

- Quel rôle les humains doivent-ils jouer dans la surveillance des systèmes d'IA (par exemple, "l'humain dans la boucle") et comment ce rôle doit-il être intégré dans le cadre de gouvernance de l'IA d'une entreprise ? Y a-t-il certaines utilisations des systèmes d'IA sur les marchés financiers pour lesquelles l'implication humaine directe dans la surveillance des systèmes d'IA est plus importante que d'autres (par exemple, les cas d'utilisation reposant sur des techniques d'apprentissage automatique qui peuvent avoir des degrés d'explicabilité moindres) ? En fonction du système d'IA, quelles sont les compétences, les connaissances, la formation et l'expertise nécessaires ? Veuillez fournir des détails et des exemples.

- Est-il possible de surveiller efficacement et en continu les systèmes d'IA afin d'identifier les variations dans les résultats des modèles en utilisant un développement fondé sur des tests, y compris des tests de résistance, des examens post-négociation, des vérifications ponctuelles et des mesures correctives de la même manière que les algorithmes de négociation fondés sur des règles afin d'atténuer les risques tels que les dérives et les hallucinations des modèles ? Dans l'affirmative, veuillez fournir des exemples. Avez-vous des suggestions sur la manière dont ces processus dérivés de la surveillance des systèmes de négociation algorithmique pourraient être adaptés aux systèmes d'IA pour les recommandations et les décisions de négociation ?

- Certains aspects du droit des valeurs mobilières exigent une documentation détaillée et une traçabilité de la prise de décision. Ce type d'enregistrement peut s'avérer difficile dans le contexte de l'utilisation de modèles reposant sur certains types de techniques d'IA. Quel niveau de transparence/explicabilité doit être intégré dans un système d'IA lors de sa conception, de sa planification et de sa construction pour que les résultats de ce système puissent être compris et expliqués par les humains ? Faut-il prévoir des règles et/ou des orientations nouvelles ou modifiées concernant l'utilisation d'un système d'IA moins explicable (par exemple, des garanties permettant de vérifier de manière indépendante la fiabilité des résultats) ?

- Les solutions FinTech qui s'appuient sur des systèmes d'IA proposant de fournir des services de KYC et d'onboarding, des conseils et d'effectuer une gestion discrétionnaire des investissements remettent en question la dépendance actuelle à l'égard de personnes compétentes.

[1] Pour plus de clarté, cette série d'articles ne traite pas de l'avis en relation avec ses orientations pour les places de marché et les participants au marché, les agences de compensation et les services d'appariement, les référentiels centraux et les rapports sur les données relatives aux produits dérivés, les organisations de notation désignées et les administrateurs de référentiels désignés.

[2] Un "Système d'IA" est un système basé sur une machine qui, pour des objectifs explicites ou implicites, déduit, à partir des données qu'il reçoit, comment générer des résultats tels que des prédictions, du contenu, des recommandations ou des décisions qui peuvent influencer des environnements physiques ou virtuels.

[3] Bureau du surintendant des institutions financières (BSIF) Guideline E-23 on Model Risk Management ; Organisation internationale de normalisation (ISO) : Normes pour l'intelligence artificielle (https://www.iso.org/artificial-intelligence) ; National Institute of Standards and Technology (NIST) Cadre de gestion des risques liés à l'IA (https://www.nist.gov/itl/ai-risk-management-framework).